КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Формула Шеннона (для неравновероятных событий)

|

|

|

|

Мощность кодируемого алфавита определяется по формуле

N=Mi,

где M - мощность кодирующего алфавита, а i - количество символов кодирующего алфавита, которыми кодируется один символ кодируемого алфавита.

Если нет отдельных указаний, то следует считать, что мощность кодирующего алфавита компьютера - 2 символа. Все современные компьютеры работают с двумя символами, единицей и нулем, поэтому все расчеты делаются исходя из этого факта.

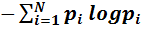

Американский ученый Клод Шеннон в 1948 году предложил формулу определения количества информации, учитывающую возможную неодинаковую вероятность сообщений в наборе.

I =  (3)

(3)

Эту меру, представляющую собой неопределенность, приходящуюся в среднем на одно состояние, называют энтропией дискретного источника информации.

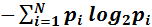

Если ориентироваться на измерение неопределенности в двоичных единицах, то основание логарифма следует принять равным двум:

I =  , (4)

, (4)

где I — количество информации;

N — количество возможных событий;

Pi — вероятности отдельных событий.

Или развернутая форма формулы:

I = — (p1log2 p1 + p2 log2 p2 +... + pNlog2pN) (5)

Пример (Формула Шеннона )

Какое количество информации будет содержать зрительное сообщение о цвете вынутого шарика, если в непрозрачном мешочке хранится: 10 белых, 20 красных, 30 синихи 40 зеленых шариков.

|

|

|

|

|

Дата добавления: 2014-11-06; Просмотров: 1445; Нарушение авторских прав?; Мы поможем в написании вашей работы!