КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Методические указания. Изучение взаимосвязей признаков явлений следует начать с рассмотрения основных видов признаков в зависимости от направления их воздействия друг на друга:

|

|

|

|

Изучение взаимосвязей признаков явлений следует начать с рассмотрения основных видов признаков в зависимости от направления их воздействия друг на друга: факторных (независимых) и анализируемых (результативных или зависимых).

Связь признака с комплексом условий может быть детерминированной (однозначно определенной), если этот комплекс охватывает все необходимые условия, достаточные для осуществления определенного (требуемого) значения данного признака, или стохастической (случайной, неоднозначно определенной), если нет.

Частным случаем стохастической зависимости случайных признаков является их корреляционная зависимость (корреляция), при которой условное математическое ожидание одного из них относительно других не равно его безусловному математическому ожиданию. От корреляции следует отличать регрессию, которая представляет собой определенный вид функциональной зависимости изменения математического ожидания одного признака при изменении значений других признаков.

Методы регрессионного анализа могут применяться при изучении рядов динамики, в частности, для их выравнивания, интерполяции и экстраполяции.

При рассмотрении аналитических группировок следует учитывать, что они являются эмпирическим выражением регрессионных зависимостей между признаками. Необходимо также ознакомиться, а также оценки степени тесноты связей, существенности учитываемых в моделях факторов и условий с помощью дисперсионного анализа на основе коэффициента детерминации.

§ 1.1. Виды связей

Статистические распределения характеризуются наличием более или менее значительной вариации в величине признака у отдельных единиц совокупности. Естественно, возникает вопрос о том, какие же причины формируют уровень признака в данной совокупности и каков конкретный вклад каждой из них.

|

|

|

Вариация каждого изучаемого признака находится в тесной связи и взаимодействии с вариацией других признаков, характеризующих исследуемую совокупность единиц. Например, вариация уровня производительности труда работников предприятий зависит от степени совершенства применяемого оборудования, технологии, организации производства, труда и управления и других самых различных факторов.

При изучении конкретных зависимостей одни признаки выступают в качестве факторов, обусловливающих изменение других признаков. Признаки этой первой группы в дальнейшем будем называть признаками-факторами (факторными признаками );а признаки, которые являются результатом влияния этих факторов, будем называть результативными.

В статистике изучают функциональную и стохастическую зависимости. Функциональная связь характеризуется полным соответствием между изменением факторного признака и изменением результативной величины. Каждому значению признака-фактора соответствуют вполне определенные значения результативного признака. Если причинная зависимость проявляется не в каждом отдельном случае, а в общем, в среднем при большом числе наблюдений, то такая зависимость называется стохастической. Частным случаем стохастической связи является корреляционная связь, при которой изменение среднего значения результативного признака обусловлено изменением факторных признаков. Связи между явлениями и их признаками классифицируются по степени тесноты, направлению и аналитическому выражению.

Приблизительно степень тесноты линейной связи можно оценить по величине коэффициента корреляции.

По направлению выделяют прямую и обратную связь. Если с увеличением или уменьшением значений факторного признака происходит увеличение или уменьшение значений результативного признака, то связь называется прямой. Если с увеличением или уменьшением значений факторного признака происходит уменьшение или увеличение значений результативного признака, то связь называется обратной.

|

|

|

По аналитическому выражению выделяют:

· прямолинейные (линейные) связи, которые могут быть приблизительно выражены уравнением прямой;

· нелинейные связи, которые выражаются уравнением какой-либо кривой линии.

Корреляционный анализ имеет своей задачей количественное определение тесноты связи между признаками. Важнейшим условием правильного применения методов корреляционного анализа является требование однородности единиц, подвергаемых изучению методами корреляционного анализа. Однородность может быть оценена с помощью коэффициента вариации. Другим важным требованием, обеспечивающим надежность выводов корреляционного анализа, является требование достаточного числа наблюдений. Включаемые в исследование факторные признаки должны быть независимы друг от друга, так как наличие тесной связи между ними свидетельствует о том, что они характеризуют одни и те же стороны изучаемого явления и в значительной мере дублируют друг друга. Все основные положения теории корреляции разрабатывались применительно к предположению о нормальном законе распределения исследуемых признаков. Поэтому целесообразным является изучение формы распределения, дающее возможность в известной мере обосновать правомерность применения методов корреляционного анализа.

Для измерения тесноты связи применяются: линейный коэффициент корреляции, теоретическое корреляционное отношение, индекс корреляции.

§ 1.2. Линейный коэффициент корреляции

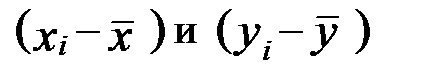

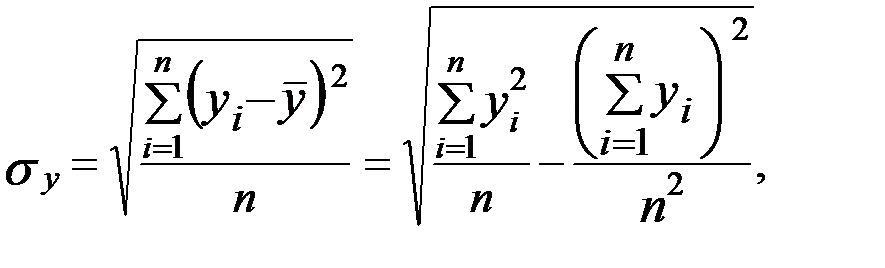

При расчете этого показателя учитываются величины отклонений индивидуальных значений признака от средней, т.е. соответственно для факторного и результативного признаков величины  . Однако непосредственно сопоставлять между собой данные абсолютные величины нельзя. Признаки могут быть выражены в разных единицах, а при одинаковых единицах измерения средние могут быть различны по величине. Сравнению подлежат отклонения, выраженные в долях среднего квадратического отклонения (нормированные отклонения). Рассчитывают среднее произведение нормированных отклонений, которое называется линейным коэффициентом корреляции:

. Однако непосредственно сопоставлять между собой данные абсолютные величины нельзя. Признаки могут быть выражены в разных единицах, а при одинаковых единицах измерения средние могут быть различны по величине. Сравнению подлежат отклонения, выраженные в долях среднего квадратического отклонения (нормированные отклонения). Рассчитывают среднее произведение нормированных отклонений, которое называется линейным коэффициентом корреляции:

|

|

|

где

.

.

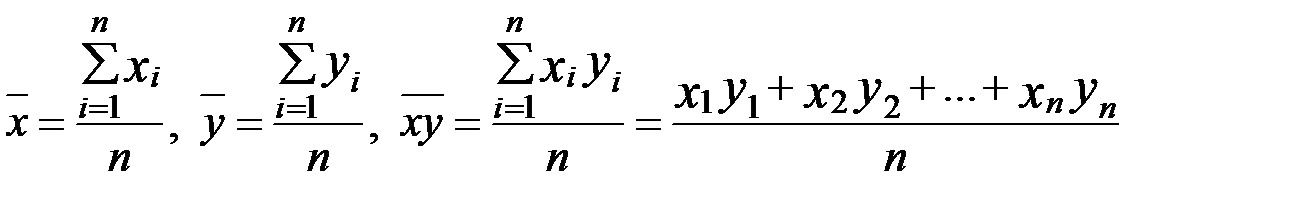

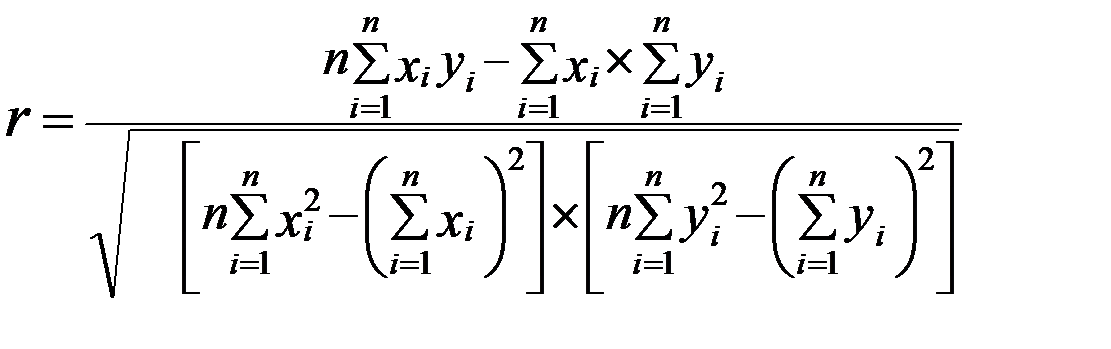

Выполнив несложные преобразования, можно получить следующую формулу для расчета линейного коэффициента корреляции:

При пользовании этой формулой отпадает необходимость вычислять отклонения индивидуальных значений признаков от средней величины, что исключает ошибку в расчетах при округлении средних величин. Направление связи и степень ее тесноты можно оценить с помощью таблицы 5.1 (при достаточно большом объеме выборки).

Линейный коэффициент корреляции может принимать любые значения в пределах от -1 до + 1. Чем ближе коэффициент корреляции по абсолютной величине к 1, тем теснее связь между признаками. Знак при линейном коэффициенте корреляции указывает на направление связи. Прямой зависимости соответствует знак плюс, а обратной зависимости – знак минус.

Линейный коэффициент корреляции применяется для измерения тесноты связи только при линейной форме связи. Равенство  говорит лишь об отсутствии линейной корреляционной зависимости, но не вообще об отсутствии корреляционной, а тем более статистической зависимости. Величина коэффициента корреляции не является доказательством наличия причинно-следственной связи между исследуемыми признаками, а является оценкой степени взаимной согласованности в изменениях признаков. Установлению причинно-следственной зависимости предшествует анализ качественной природы явлений. Особенно осторожно следует подходить к истолкованию полученных коэффициентов корреляции при незначительных объемах выборочной совокупности.

говорит лишь об отсутствии линейной корреляционной зависимости, но не вообще об отсутствии корреляционной, а тем более статистической зависимости. Величина коэффициента корреляции не является доказательством наличия причинно-следственной связи между исследуемыми признаками, а является оценкой степени взаимной согласованности в изменениях признаков. Установлению причинно-следственной зависимости предшествует анализ качественной природы явлений. Особенно осторожно следует подходить к истолкованию полученных коэффициентов корреляции при незначительных объемах выборочной совокупности.

Таблица 1. 1

Исследование связи по коэффициенту корреляции

Значение коэффициента корреляции

| Степень тесноты связи | Направление связи |

| линейная связь отсутствует | - |

| очень слабая | обратная |

| очень слабая | прямая |

| слабая | обратная |

| слабая | прямая |

| умеренная | обратная |

| умеренная | прямая |

| тесная | обратная |

| тесная | прямая |

| очень тесная | обратная |

| очень тесная | прямая |

| функциональная линейная | обратная |

| функциональная линейная | прямая |

|

|

|

Строго говоря, значимость коэффициента корреляции необходимо исследовать с помощью  статистики. Пусть по результатам выборочного наблюдения

статистики. Пусть по результатам выборочного наблюдения  . Объясняется ли это действительно существующей корреляционной связью между признаками

. Объясняется ли это действительно существующей корреляционной связью между признаками  в генеральной совокупности или является следствием случайности отбора элементов в выборку?

в генеральной совокупности или является следствием случайности отбора элементов в выборку?

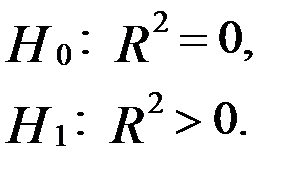

По вычисленному значению выборочного коэффициента корреляции  требуется проверить гипотезу

требуется проверить гипотезу

Н0: коэффициент корреляции в генеральной совокупности равен нулю

при альтернативе

Н1: коэффициент корреляции в генеральной совокупности не равен нулю.

В качестве статистического критерия для гипотезы Н0 обычно используется величина

которая распределена по закону Стьюдента с  степенями

степенями

свободы. Некоторые значения критерия приведены в табл. 1.2.

Таблица 1. 2

Допустимые значения критерия Стьюдента

при числе степеней свободы  и уровне значимости

и уровне значимости  .

.

|

|

|

| ||

| 0,05 | 0,01 | 0,05 | 0,01 | ||

|

| ||||

| 2,57 | 4,03 | 2,10 | 2,88 | ||

| 2,45 | 3,71 | 2,09 | 2,86 | ||

| 2,36 | 3,50 | 2,09 | 2,85 | ||

| 2,31 | 3,36 | 2,08 | 2,83 | ||

| 2,26 | 3,25 | 2,07 | 2,82 | ||

| 2,23 | 3,17 | 2,07 | 2,81 | ||

| 2,20 | 3,11 | 2,06 | 2,80 | ||

| 2,18 | 3,05 | 2,06 | 2,79 | ||

| 2,16 | 3,01 | 2,06 | 2,78 | ||

| 2,14 | 2,98 | 2,05 | 2,77 | ||

| 2,13 | 2,95 | 2,05 | 2,76 | ||

| 2,12 | 2,92 | 2,05 | 2,76 | ||

| 2,11 | 2,90 | 2,04 | 2,75 |

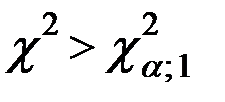

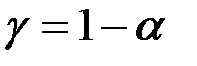

Гипотеза Н0 отвергается (т.е. зависимость считается установленной), если  превысит допустимое значение

превысит допустимое значение  при уровне значимости

при уровне значимости  и

и  степенями свободы. Связь между случайными величинами считается установленной с достоверностью

степенями свободы. Связь между случайными величинами считается установленной с достоверностью  .

.

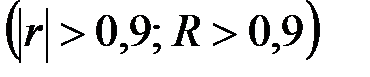

Ниже также приведена таблица 1.3 для критических значений  самого коэффициента корреляции. Корреляция между случайными величинами признается значимой с достоверностью

самого коэффициента корреляции. Корреляция между случайными величинами признается значимой с достоверностью  , если

, если

, (

, ( - число наблюдений).

- число наблюдений).

Таблица 1.3

Критические значения коэффициента корреляции

| Доверительная вероятность

|

| Доверительная вероятность

| ||||

| 0,90 | 0,95 | 0,99 | 0,90 | 0,95 | 0,99 | ||

| 0,988 | 0,997 | 1,000 | 0,476 | 0,553 | 0,684 | ||

| 0,900 | 0,950 | 0,990 | 0,457 | 0,532 | 0,661 | ||

| 0,805 | 0,878 | 0,959 | 0,441 | 0,514 | 0,641 | ||

| 0,729 | 0,811 | 0,917 | 0,426 | 0,497 | 0,623 | ||

| 0,669 | 0,754 | 0,874 | 0,412 | 0,482 | 0,606 | ||

| 0,621 | 0,707 | 0,834 | 0,400 | 0,468 | 0,590 | ||

| 0,582 | 0,666 | 0,798 | 0,389 | 0,456 | 0,575 | ||

| 0,549 | 0,632 | 0,765 | 0,378 | 0,444 | 0,561 | ||

| 0,521 | 0,602 | 0,735 | 0,369 | 0,443 | 0,549 | ||

| 0,497 | 0,576 | 0,708 | 0,360 | 0,432 | 0,537 |

Коэффициент корреляции достаточно точно оценивает степень тесноты связи лишь в случае линейной зависимости между признаками. При криволинейной зависимости линейный коэффициент корреляции недооценивает степень тесноты связи и даже может быть равен 0, а потому в таких случаях рекомендуется использовать в качестве показателя степени тесноты связи другие величины.

§ 1.3. Эмпирическое корреляционное отношение

Согласно правилу сложения дисперсий, общая дисперсия  равна сумме средней из групповых и межгрупповой дисперсий:

равна сумме средней из групповых и межгрупповой дисперсий:

.

.

Первая составляющая – межгрупповая дисперсия  , характеризует ту часть колеблемости результативного признака, которая складывается под влиянием изменения признака-фактора, положенного в основу группировки. Вариацию, обусловленную влиянием прочих факторов, характеризует средняя из групповых дисперсий

, характеризует ту часть колеблемости результативного признака, которая складывается под влиянием изменения признака-фактора, положенного в основу группировки. Вариацию, обусловленную влиянием прочих факторов, характеризует средняя из групповых дисперсий  .

.

Зная общую и межгрупповую дисперсии, можно оценить долю, которую составляет вариация под действием фактора  в общей вариации результативного признака

в общей вариации результативного признака  , т.е. найти отношение

, т.е. найти отношение  .

.

Извлекая, квадратный корень из этого отношения, получим эмпирическое корреляционное отношение

или

или

Корреляционное отношение равно нулю, когда нет колеблемости в величине средних значений результативного признака по выделенным группам. В тех случаях, когда средняя из групповых дисперсий близка к нулю, т.е. практически вся вариация результативного признака обусловлена действием фактора  , величина корреляционного отношения близка к 1. Направление связи мы легко установим по данным групповой таблицы. Вычисление корреляционного отношения рассмотрено в части 1.

, величина корреляционного отношения близка к 1. Направление связи мы легко установим по данным групповой таблицы. Вычисление корреляционного отношения рассмотрено в части 1.

§ 1.4. Регрессионный анализ. Индекс корреляции

Регрессионный анализ заключается в определении аналитического выражения связи, в котором изменение одной величины (называемой зависимой или результативным признаком), обусловлено влиянием одной или нескольких независимых величин (факторов).Вычисляя параметры теоретической линии связи, мы отчасти устраняем влияние случайностей и получаем однозначное (по форме) изменение фактора  с изменением фактора

с изменением фактора  .

.

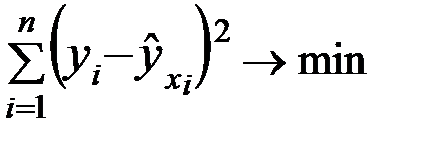

Эмпирической линией регрессии называется линия, вокруг которой группируются точки корреляционного поля и которая указывает основное направление, основную тенденцию связи между признаками. Для взаимного погашения случайных причин линия регрессии проводится так, чтобы сумма отклонений точек поля корреляции от соответствующих точек эмпирической линии регрессии равнялась нулю, а сумма квадратов этих отклонений была бы минимальной величиной (метод наименьших квадратов).

Замечание. Линию регрессии, построенную по выборочным данным следует называть «эмпирической линией регрессии». В стандартных учебниках по общей теории статистики ее обычно называют «теоретической линией регрессии». На самом деле термин «теоретическое уравнение регрессии» относится к генеральной совокупности, его параметры оцениваются по выборочным данным. Уравнение, полученной в результате оценки называется «эмпирическим уравнением регрессии». Здесь возможна некоторая путаница при ответе на тесты с сайта fepo.ru. Необходимо догадаться какой терминологии придерживается автор вопроса.

Главным основанием для выбора вида уравнения связи должен служить содержательный анализ природы изучаемой зависимости, ее механизма. Однако на основе теоретического анализа обычно могут быть сделаны лишь самые общие выводы относительно направления связи. Необходимым дополнением такого рода предположений должен быть анализ конкретных фактических данных. Одним из элементов конкретных исследований является сопоставление различных уравнений зависимости, основанное на использовании критериев качества аппроксимации эмпирических данных конкурирующими вариантами моделей.

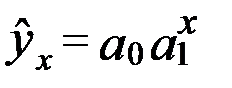

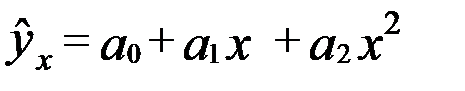

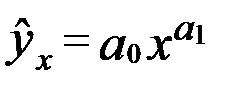

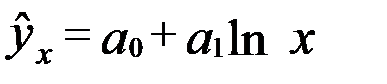

Наиболее часто для характеристики связей экономических показателей используют следующие типы функций:

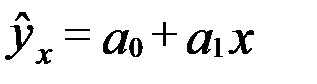

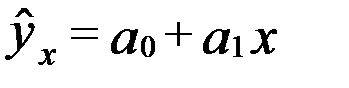

· линейную

· гиперболическую

· показательную

· параболическую

· степенную

· логарифмическую

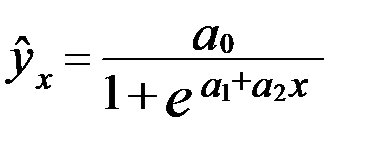

· логистическую

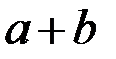

Рассмотрим уравнение прямой линии  . Для нахождения параметров

. Для нахождения параметров  и

и  уравнения регрессии используем метод наименьших квадратов: сумма квадратов отклонений фактических точек от эмпирической линии регрессии должна быть минимальной:

уравнения регрессии используем метод наименьших квадратов: сумма квадратов отклонений фактических точек от эмпирической линии регрессии должна быть минимальной:

В случае линейной зависимости, получим

Необходимым условием экстремума является равенство нулю частных производных по параметрам. Приравнивая к нулю частные производные функции  по параметрам

по параметрам  и

и  , получим систему линейных уравнений для нахождения параметров по выборочным данным:

, получим систему линейных уравнений для нахождения параметров по выборочным данным:

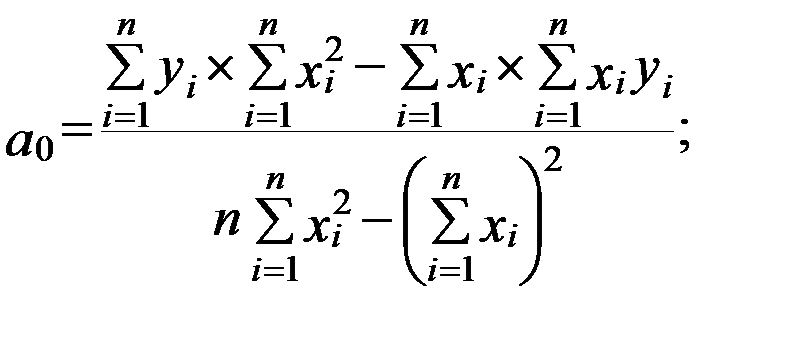

Решение данной системы имеет следующий вид:

Параметр  в линейном уравнении называют коэффициентом регрессии. При наличии прямой корреляционной зависимости коэффициент регрессии имеет положительное значение, а в случае обратной зависимости коэффициент регрессии – отрицательный.

в линейном уравнении называют коэффициентом регрессии. При наличии прямой корреляционной зависимости коэффициент регрессии имеет положительное значение, а в случае обратной зависимости коэффициент регрессии – отрицательный.

Коэффициент регрессии показывает, на сколько единиц в среднем изменяется величина результативного признака  при изменении факторного признака

при изменении факторного признака  на единицу.

на единицу.

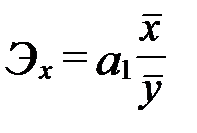

Коэффициент регрессии  применяют для определения коэффициента эластичности

применяют для определения коэффициента эластичности  , который показывает, на сколько процентов изменится величина результативного признака

, который показывает, на сколько процентов изменится величина результативного признака  при изменении признака-фактора

при изменении признака-фактора  на один процент. В случае линейной зависимости можно приближенно записать

на один процент. В случае линейной зависимости можно приближенно записать

.

.

Точная формула в данном случае имеет вид

,

,

т. е. в каждой точке  получим различные значения коэффициента эластичности.

получим различные значения коэффициента эластичности.

Линейный коэффициент корреляции  и коэффициент регрессии

и коэффициент регрессии  связаны соотношением:

связаны соотношением:

Наличие этого соотношения дает возможность производить вычисление коэффициента корреляции и параметров уравнения линейной регрессии одновременно.

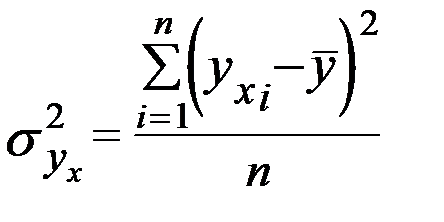

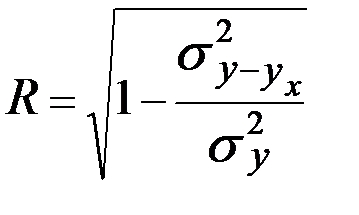

Теоретическое корреляционное отношение (индекс корреляции) применяется для измерения тесноты корреляционной связи между признаками при любой форме связи, как линейной, так и нелинейной. Данный показатель можно вычислять только после того, как определена эмпирическая линия регрессии. Он рассчитывается по формуле:

где  - факторная дисперсия, которая характеризует вариацию результативного признака

- факторная дисперсия, которая характеризует вариацию результативного признака  под влиянием признака-фактора

под влиянием признака-фактора  ,

,  - общая дисперсия, показывающая вариацию результативного признака под влиянием всех факторов, вызывающих эту вариацию. Если ввести в формулу остаточную дисперсию, которая характеризует вариацию результативного признака под влиянием прочих неучтенных факторов

- общая дисперсия, показывающая вариацию результативного признака под влиянием всех факторов, вызывающих эту вариацию. Если ввести в формулу остаточную дисперсию, которая характеризует вариацию результативного признака под влиянием прочих неучтенных факторов

то получим

.

.

Коэффициент детерминации в регрессионной модели рассчитывается по формуле

.

.

Он показывает, какая часть общей дисперсии результативного признака объясняется влиянием факторного признака.

Замечание. Термин «теоретическое корреляционное отношение» употребляют в стандартных учебниках по теории статистики. На самом деле данный показатель рассчитывается по выборочным данным.

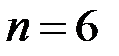

Пример 1. 1.

На основе выборочных данных о деловой активности однотипных коммерческих структур оценить тесноту связи между прибылью  (млн. руб.) и затратами на 1 руб. произведенной продукции

(млн. руб.) и затратами на 1 руб. произведенной продукции  (коп.).

(коп.).

В этом учебном примере взято небольшое число данных  , обычно полагают, что объем выборки должен в 5 – 6 и более раз превышать число коэффициентов в уравнении.

, обычно полагают, что объем выборки должен в 5 – 6 и более раз превышать число коэффициентов в уравнении.

Определим параметры уравнения парной линейной регрессии  :

:

Таблица 1. 4

Расчетная таблица для определения уравнения регрессии, коэффициента корреляции и корреляционного отношения

| № п/п |

|

|

|

|

|

|

|

|

| 247,5 | -26,5 | 702,25 | ||||||

| 1012,9 | 57,1 | 3260,41 | ||||||

| 1012,9 | -11,9 | 141,61 | ||||||

| 529,5 | 76,5 | 5852,25 | ||||||

| 811,5 | -32,5 | 1056,25 | ||||||

| 851,7 | -62,7 | 3931,29 | ||||||

| Сумма | 4466,0 | 14944,06 |

Таким образом, уравнение имеет вид  .

.

Рассчитаем коэффициент корреляции

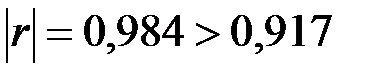

В данном примере  (см. табл. 1.3), поэтому корреляционная связь считается установленной с достоверностью 99%.

(см. табл. 1.3), поэтому корреляционная связь считается установленной с достоверностью 99%.

Рассчитаем корреляционное отношение. Общая дисперсия результативного признака равна

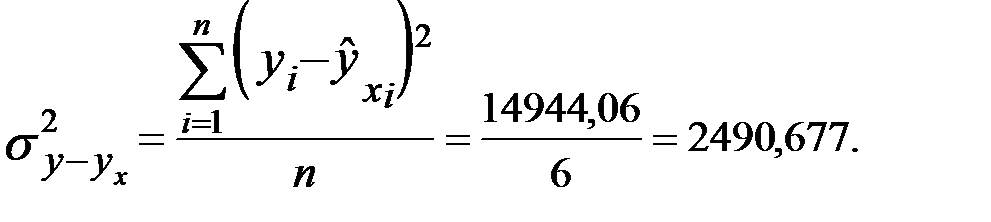

Остаточная дисперсия равна

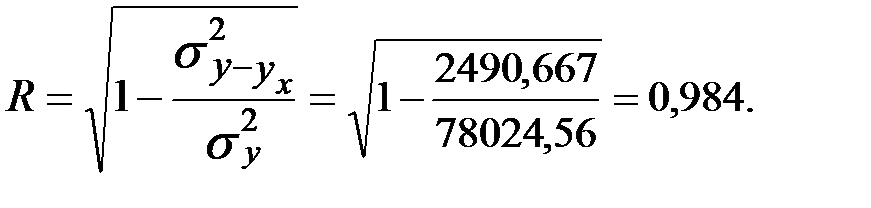

Тогда корреляционное отношение равно

Известно, что в случае парной линейной регрессии  .

.

Коэффициент детерминации равен

Следовательно, вариация прибыли на 96,8% объясняется вариацией затрат.

В эконометрике качество уравнения регрессии определяется путем исследования статистической значимости коэффициента детерминации.

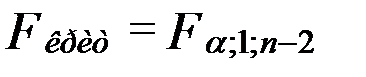

Для проверки гипотезы в случае парной линейной регрессии рассчитывается  статистика по формуле

статистика по формуле

.

.

Величина  при выполнении некоторых предпосылок и при справедливости

при выполнении некоторых предпосылок и при справедливости  имеет распределение Фишера. Показатели

имеет распределение Фишера. Показатели  и

и  равны или не равны нулю одновременно. Для проверки нулевой гипотезы

равны или не равны нулю одновременно. Для проверки нулевой гипотезы  при заданном уровне значимости

при заданном уровне значимости  по таблицам критических точек распределения Фишера находится критическое значение

по таблицам критических точек распределения Фишера находится критическое значение  . Нулевая гипотеза отклоняется, если

. Нулевая гипотеза отклоняется, если  . Это равносильно тому, что

. Это равносильно тому, что  , т.е.

, т.е.  статистически значим.

статистически значим.

Критические значения  - статистики можно определить с помощью программы Microsoft Office Excel. Нажать

- статистики можно определить с помощью программы Microsoft Office Excel. Нажать  , выбрать статистическую функцию FРАСПОБР. Задать вероятность равную уровню значимости

, выбрать статистическую функцию FРАСПОБР. Задать вероятность равную уровню значимости  . Первое число степеней свободы соответствует числу объясняющих переменных в линейной модели, второе – числу наблюдений за вычетом числа оцениваемых параметров.

. Первое число степеней свободы соответствует числу объясняющих переменных в линейной модели, второе – числу наблюдений за вычетом числа оцениваемых параметров.

Рассчитаем коэффициент эластичности

Таким образом, связь между признаками обратная  , при большем объеме выборки ее можно было бы полагать очень тесной

, при большем объеме выборки ее можно было бы полагать очень тесной  . Если затраты на 1 руб. произведенной продукции растут на 1%, то прибыль уменьшается на 4,5%.

. Если затраты на 1 руб. произведенной продукции растут на 1%, то прибыль уменьшается на 4,5%.

§ 1.5. Взаимосвязь качественных признаков. Коэффициенты ассоциации, контингенции, Пирсона и Чупрова

При наличии соотношения между вариацией качественных признаков говорят об их ассоциации, взаимосвязанности. Для оценки связи в этом случае используют нижеследующие показатели.

Для определения тесноты связи двух качественных альтернативных признаков, каждый из которых состоит только из двух групп (имеет две альтернативы), применяются коэффициенты ассоциации и контингенции.

Таблица 1. 5

Таблица частот для вычисления коэффициентов

|

|

|

|

|

|

|

|

|

Где  - частоты. Например,

- частоты. Например,  - число наблюдений, в которых у объектов одновременно встречаются первые альтернативы обоих признаков.

- число наблюдений, в которых у объектов одновременно встречаются первые альтернативы обоих признаков.

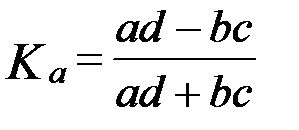

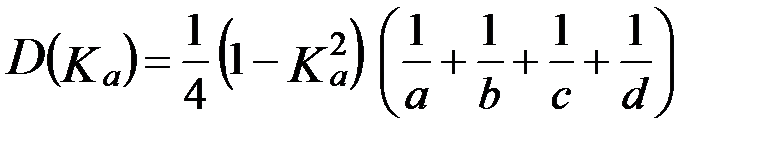

Коэффициент ассоциации

.

.

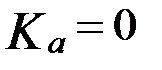

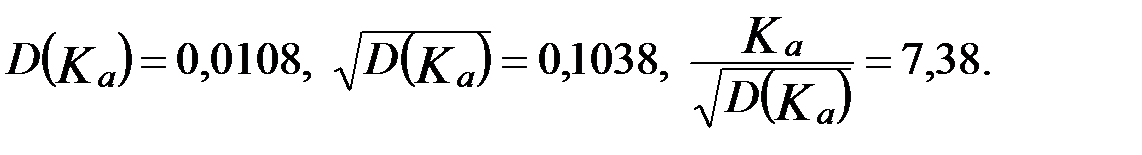

Последняя формула следует из коэффициента корреляции, если использовать бинарные переменные. Если признаки независимы, то  . В случае полной связи между признаками

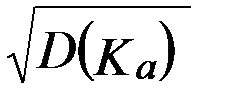

. В случае полной связи между признаками  . Дисперсия коэффициента ассоциации равна

. Дисперсия коэффициента ассоциации равна

.

.

Сравнение  с

с  позволяет в первом приближении получить оценку степени связи. Обычно полагают наличие связи при

позволяет в первом приближении получить оценку степени связи. Обычно полагают наличие связи при  .

.

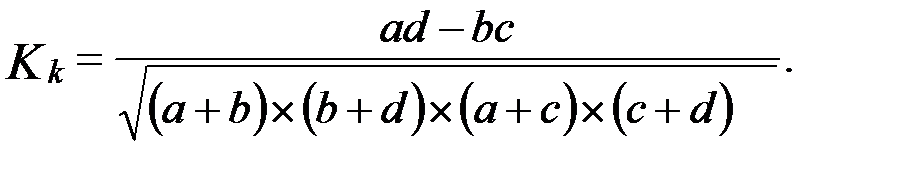

Коэффициент контингенции (сходства)

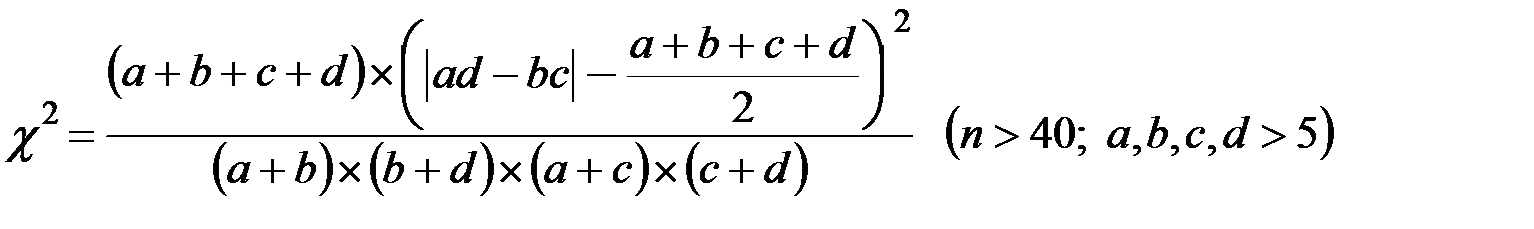

На практике для проверки гипотезы о существовании взаимосвязи между изучаемыми признаками рассчитывается статистика хи - квадрат

.

.

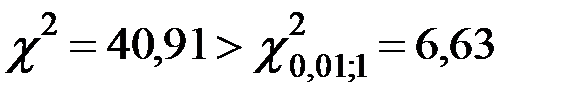

Если  , то с достоверностью

, то с достоверностью  зависимость признаков признается значимой. Число степеней свободы в данном случае равно 1. Критические значения

зависимость признаков признается значимой. Число степеней свободы в данном случае равно 1. Критические значения  - статистики можно определить с помощью программы Microsoft Office Excel. Нажать

- статистики можно определить с помощью программы Microsoft Office Excel. Нажать  , выбрать статистическую функцию ХИ2ОБР. Задать вероятность равную уровню значимости

, выбрать статистическую функцию ХИ2ОБР. Задать вероятность равную уровню значимости  (например, 0,05 или 0,01) и число степеней свободы.

(например, 0,05 или 0,01) и число степеней свободы.

Пример 1. 2.

Исследуем связь между участием в забастовках рабочих и уровнем их образования. Результаты обследования представлены в табл. 1.6.

Таблица 1. 6

Зависимость участия рабочих в забастовках

от образовательного уровня

| Группы рабочих | Число рабочих | Из них | |

| участвующих в забастовке | не участвующих в забастовке | ||

| Имеют среднее образование | |||

| Не имеют среднего образования | |||

| Итого |

Коэффициент ассоциации велик по сравнению со своим среднеквадратическим отклонением.

Рассчитаем коэффициент контингенции.

.

.

Таким образом, с вероятностью 0,99 связь между участием в забастовках и их образовательным уровнем имеет место.

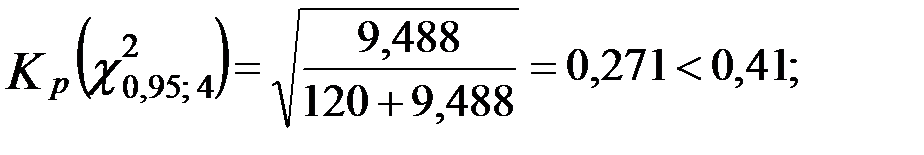

Когда каждый из качественных признаков состоит более чем из двух групп, то для определения тесноты связи возможно применение коэффициентов взаимной сопряженности Пирсона и Чупрова, которыевычисляются по формулам:

.

.

Расчетное значение критерия  (хи-квадрат) определяется по формуле

(хи-квадрат) определяется по формуле

,

,

где

- число значений (групп) первого признака;

- число значений (групп) первого признака;  - число значений (групп) второго признака;

- число значений (групп) второго признака;  теоретические частоты. Коэффициент Пирсона рассчитывается только для квадратных таблиц, т.е.

теоретические частоты. Коэффициент Пирсона рассчитывается только для квадратных таблиц, т.е.  .

.

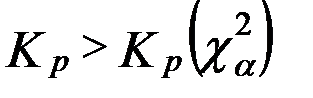

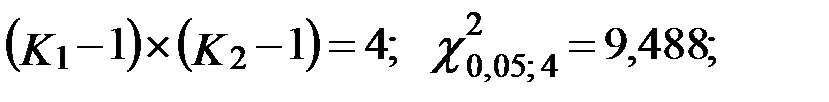

Так как коэффициенты Пирсона и Чупрова выражаются через критерий хи-квадрат, то проверка их значимости может быть произведена через критические точки этого распределения. Связь признается существенной с достоверностью  , если

, если  или

или  . При этом число степеней свободы распределения хи-квадрат равно

. При этом число степеней свободы распределения хи-квадрат равно  .

.

Таблица 1. 7

Вспомогательная таблица для расчета

коэффициента взаимной сопряженности

| Y X | I | II | III | Всего |

| I |

|

|

|

|

| II |

|

|

|

|

| III |

|

|

|

|

| Итого |

|

|

|

|

Чем ближе величина  к 1, тем теснее связь.

к 1, тем теснее связь.

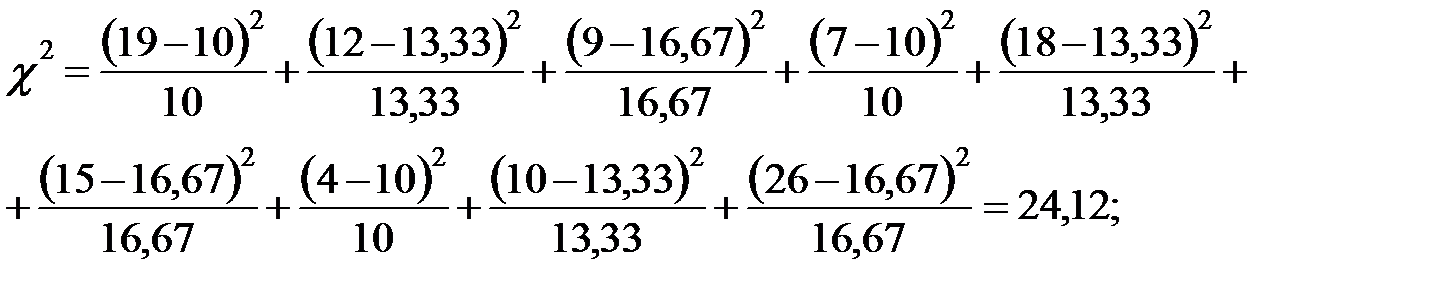

Пример 1. 3.

Таблица 1. 8

Зависимость между себестоимостью продукции и

накладными расходами на реализацию

| Накладные расходы | Себестоимость | Итого | ||

| Низкая | Средняя | Высокая | ||

| Низкие | 19 (10) | 12 (13,33) | 9 (16,67) | |

| Средние | 7 (10) | 18 (13,33) | 15 (16,67) | |

| Высокие | 4 (10) | 10 (13,33) | 26 (16,67) | |

| Итого |

В таблице 1.8 в скобках указаны теоретические частоты  .

.

С помощью коэффициента взаимной сопряженности исследуем связь между себестоимостью продукции и накладными расходами на реализацию.

.

.

Связь установлена с достоверностью 0,95.

|

|

|

|

|

Дата добавления: 2014-12-23; Просмотров: 920; Нарушение авторских прав?; Мы поможем в написании вашей работы!