КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Передача информации при помехах

|

|

|

|

На рис.1.6.1 приведена схема (структурная) передачи сообщений по каналу с помехами. Шумы (помехи) существенно снижают уверенность в том, что передано то или иное сообщение и тот или иной элемент сообщения.

Возникают две проблемы: повышение эффективности передачи и повышение достоверности (помехоустойчивости) передачи.

Действительно если из-за влияния помех при передаче i –го элемента принят j –ый элемент, то имеем прирост информации

DIi,j=log2 (1/Pi) - log2 (1/Pj(i))= log2 (Pj(i)/Pi) (3.8)

здесь Pi – безусловная (априорная) вероятность передачи i – го элемента;

Pj(i) – условная вероятность того, что при передаче i-го элемента принят j-ый элемент.

Здесь можно рассматривать два крайних случая:

1) при очень больших шумах [Pj(i)=Pi], тогда из формулы (3.8) имеем

DIi,j=log21=0 (3.9)

т.е., информации нет, принимаются только искаженные сигналы.

2) при отсутствии шумов [Pj(i)=1, если i=j и Pj(i)=0, если j≠i ], тогда из формулы (3.8) имеем:

DIi,j=log2 (1/Pi) = - log2 -Pi= log2 (Pi) (3.10)

т.е. получаем канал близкий к идеальному (без помех и искажений), где прием сообщений становится достоверным событием, что соответствует формуле 1.2.5 на странице 9.

Скорость передачи информации (в двоичных единицах на символ) в канале с шумами равна (для идеального канала, как уже отмечалось)

Zc=SPiPj(i) DIi,j=Hi-Hj(I)=Hj-Hi(j) (3.11)

Смотри также формулу 1.5.6 при m0=1, где

Hi=-SPi logPi – энтропия источника;

Hj=-SPj logPj – энтропия приемника.

- условные энтропии (3.12)

- условные энтропии (3.12)

Для канала без шумов мы имеем

Hi(j)=Hj(i)=0 (3.13)

и тогда после подстановки в 3.11 имеем:

Zc=Hi=Hj

В канале же с шумами скорость передачи информации

(3.14)

(3.14)

здесь S=1/τ - число передаваемых символов в секунду.

Zc=Hi-Hj(i) (3.15)

и после подстановки 3.15 в (3.14) имеем

|

|

|

R =S [Hi-Hj(i)] (3.16)

Т.е. скорость в канале с шумами есть разница между переданной и потерянной информацией вследствие действия помех. (см. рис. 1.7.1)

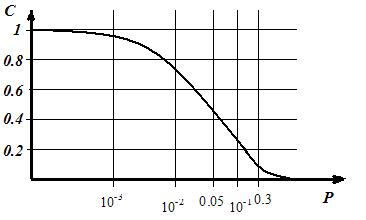

Рис. 1.7. Зависимость емкости «бинарного» канала с шумами от вероятности искажения сообщения Р.

Скорость передачи информации при воздействии шумов уменьшается более резко, чем число правильных принятых символов.

Выражение (3.16) как доказал Шеннон, показывает, что если энтропия источника информации не превышает пропускной способности канала, т.е. H≤C, то существует код, обеспечивающий передачу информации через канал с шумами со сколь угодно малой частотой ошибок.

При H>C такого кода не существует, т.е. невозможна передача без ошибок.

Полученный Шенноном результат представляет собой одну из основных теорем теории информации.

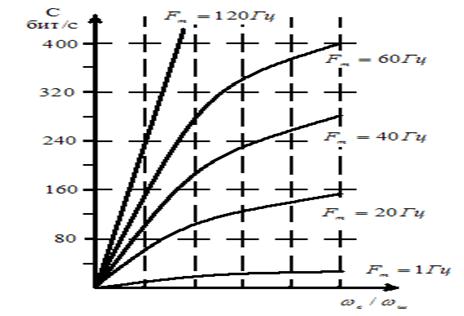

К. Шенноном же была определена пропускная способность или емкость канала связи при ограниченной средней мощности аналогового сигнала и равномерном спектре сигнала и помехи:

C=Fm log2(1+Wc/Wш) (3.17)

где: F- полоса частот канала;

Wc- средняя мощность сигнала;

Wш- средняя мощность белого шума (с равномерным спектром) с нормальным законом распределения амплитуд в полосе частот канала связи.

Следовательно, можно передавать информацию по каналу с помехами без ошибок, если скорость передачи информации

R≤C=Fm log2 (1+Wc/Wш) (3.18)

Для R>C при любой системе кодирования частота ошибок конечна, при чем она быстро растет с увеличением R (скорости).

Из формулы (3.18) следует, что в канале с высоким уровнем шумов, т.е. при Wc<<Wш емкость канала резко уменьшается. При малых Wc/Wш выражение (3.18) можно разложить в ряд и ограничиться одним членом ряда (3.19)

C=Fm log 2 (1+Wc/Wш) = Fm log2 (Wc/Wm)= 1,44 Fm (Wc/Wm) (3.19)

Из (3.19) следует, что емкость канала связи неограниченно возрастает с Wш→0.

Однако практически это невозможно из-за аппаратурных погрешностей и шумов, уменьшающих пропускную способность (емкость) канала.

Однако практически это невозможно из-за аппаратурных погрешностей и шумов, уменьшающих пропускную способность (емкость) канала.

|

|

|

На рис. 1.7 представлена зависимость пропускной способности канала для различных значений полосы частот канала.

Рис. 1.8

(назад в оглавление)

|

|

|

|

Дата добавления: 2014-01-06; Просмотров: 611; Нарушение авторских прав?; Мы поможем в написании вашей работы!