КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Здесь последний множитель является производной сигмоиды, т.е. для другого вида активационной функции будут выглядеть по-другому

|

|

|

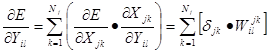

|

3. Вычисляется производная ошибки по весу связи:

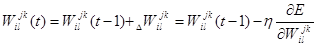

4. Корректируется вес связи:

где h (0<h<1) - коэффициент скорости обучения.

5. Если дошли до 0-го слоя - выход.

6. Вычисляется (аналогично п. 1) производная ошибки по активности элемента предыдущего слоя:

Здесь суммирование производится по всем нейронам j-го слоя, связанным с данным нейроном i-го слоя.

7. Вычисляется (аналогично п. 2) производная ошибки по входу элемента i-го слоя:

8. Переход на п. 3 и продолжение вычислений с заменой индексов

j на i и i на i-1.

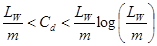

Емкостью НС называют число входных образов, которые она способна научиться распознавать. Для двухслойных НС детерминистская емкость сети Cd оценивается следующим образом:

где LW – число подстраиваемых весов, m – число нейронов в выходном слое.

Детерминистской емкостью является емкость НС для задач, не обладающих специфичностью. Во многих реальных задачах пространство входных образов обладает некоторой регулярностью, что снижает требования к емкости НС, поэтому реальная емкость НС может быть в два раза выше детерминистской.

Вопрос о емкости НС тесно связан с вопросом о мощности выходного слоя НС.

По этому поводу отметим:

1) Для разделения множества входных образов на два класса достаточно одного выходного нейрона. На двух выходных нейронах можно закодировать четыре класса.

2) Для повышения достоверности классификации каждому распознаваемому классу выделяют один нейрон выходного слоя.

3) Для большего повышения достоверности каждому классу выделяют несколько нейронов выходного слоя, каждый из которых обучается распознавать класс с некоторой степенью достоверности (например, высокой, средней, низкой).

Недостатки алгоритма обратного распространения:

|

|

|

|

Дата добавления: 2014-01-20; Просмотров: 527; Нарушение авторских прав?; Мы поможем в написании вашей работы!