КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Обучение нейросети

|

|

|

|

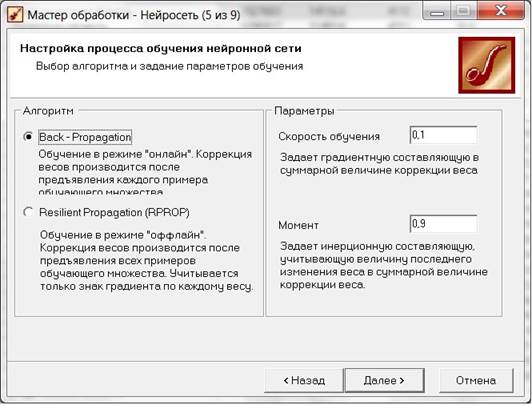

Следует выбрать алгоритм обучения:

1) Метод обратного распространения ошибки (минимизация среднеквадратического отклонения текущих значений выходов от требуемых). Характеризуется высокой надежностью, но требует большое количество итераций. Требует указания двух параметров – это скорость обучения (величина шага при итерационной коррекции весов в нейросети, рекомендуемое значение от 0 до 1) и момент (задается от 0 до 1, рекомендуется 0,9).

2) Метод эластичного распространения. Так называемое обучение по эпохам, когда коррекция весов происходит после предъявления сети всех примеров из обучающей выборки. Обеспечивает большую скорость обучения за счет осуществления сходимости в методе. Для этого алгоритма указываются параметры: шаг спуска (коэффициент увеличения скорости обучения, который определяет шаг увеличения скорости обучения при недостижении алгоритмом оптимального результата) и шаг подъема (коэффициент уменьшения скорости обучения в случае попуска оптимального результата).

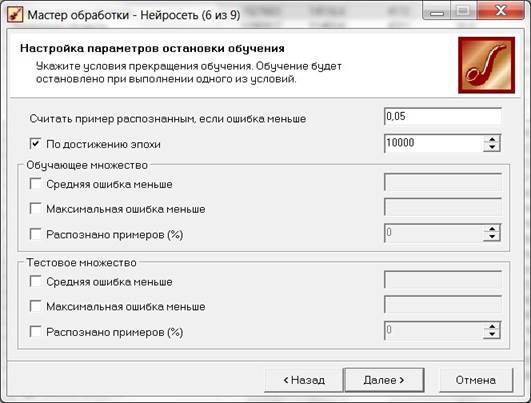

Далее необходимо задать условия, при выполнении которых обучение будет прекращено:

-считать пример распознанным, если ошибка меньше;

-по достижении эпохи;

-обучающее множество;

-тестовое множество.

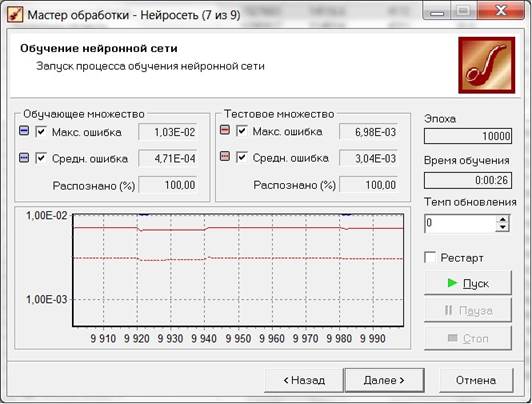

Теперь все готово к процессу обучения нейросети. В начале все веса инициализируются случайными значениями. Обучение может с большей долей вероятности считаться успешным, если процент распознанных примеров на обучающем и тестовом множествах достаточно велик (близок к 100%).

В качестве выходного параметра выбираем среднедушевой денежный доход.

Все остальные параметры будут входными.

С помощью нажатия кнопки «Пуск» начинаем обучение.

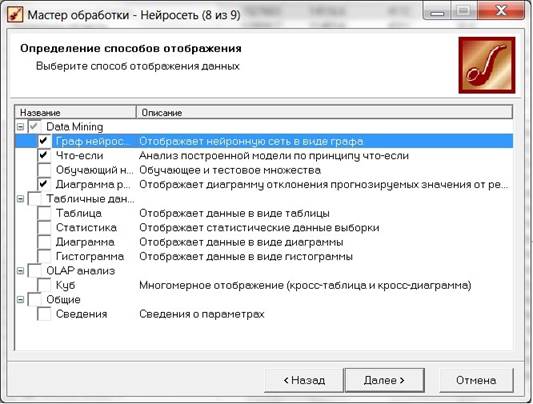

Обученную нейросеть можно использовать ля выработки управляющих воздействий. Это можно сделать, применяя анализ «что-если».

Выбираем способ отображения данных: Граф нейросети, Что-если, Диаграмма рассеяния.

|

|

|

|

|

Дата добавления: 2015-06-04; Просмотров: 406; Нарушение авторских прав?; Мы поможем в написании вашей работы!