КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Случай 2. Корректировка синаптических весов скрытого слоя

|

|

|

|

Для модели нейронной сети на рис. 1, это будут веса соответствующие слоям  и

и  . Определимся, что индексом

. Определимся, что индексом  будем обозначать нейрон из которого выходит синаптический вес, а

будем обозначать нейрон из которого выходит синаптический вес, а  – нейрон в который входит (обратите внимание на появление новой переменной

– нейрон в который входит (обратите внимание на появление новой переменной  ):

):

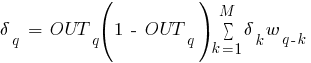

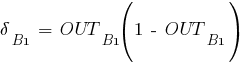

Введем величину  , которая равна:

, которая равна:

где:

– сумма от

– сумма от  по

по  .

.

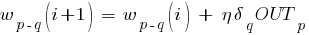

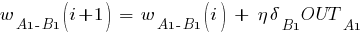

Тогда, веса скрытых слоев после коррекции будут равны:

Приведем пример вычислений для синаптического веса  :

:

Для каждого нейрона в скрытом слое должно быть вычислено  и подстроены все веса, ассоциированные с этим слоем. Этот процесс повторяется слой за слоем по направлению к входу, пока все веса не будут подкорректированы.

и подстроены все веса, ассоциированные с этим слоем. Этот процесс повторяется слой за слоем по направлению к входу, пока все веса не будут подкорректированы.

Появление алгоритма обратного распространения ошибки стало знаковым событием в области развития нейронных сетей, так как он реализует вычислительно эффективный метод обучения многослойного персептрона. Будет неправильно утверждать, что алгоритм обратного распространения ошибки предлагает действительно оптимальное решение всех потенциально разрешимым проблем, однако он развеял пессимизм относительно обучения многослойных машин, воцарившийся в результате публикации Минского в 1969 году.

43. Стохастическое обучение нейронной сети.

http://elib.bsu.by/bitstream/123456789/9654/1/18.pdf

http://www.intuit.ru/department/ds/neuronnets/7/

Стохастические методы полезны как для обучения искусственных нейронных сетей, так и для получения выхода от уже обученной сети. Стохастические методы обучения приносят большую пользу, позволяя исключать локальные минимумы в процессе обучения. Но с ними также связан ряд проблем.

|

|

|

|

Дата добавления: 2014-01-04; Просмотров: 500; Нарушение авторских прав?; Мы поможем в написании вашей работы!