КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Выбор длины шага

|

|

|

|

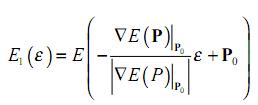

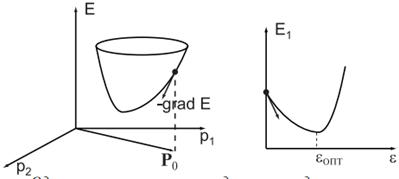

Вообще говоря, лучший выбор длины шага — точная одномерная оптимизация функции E вдоль вектора антиградиента. Требуется найти минимум функции

где P0 — текущий вектор параметров, ε > 0 — независимая переменная. Найденное значение ε ОПТ =

|

Рис.. Одномерная оптимизация для поиска длины шага.

Cуществует множество способов для решения задачи одномерной оптимизации: дихотомии, метод Ньютона, Фибоначчи, золотого сечения. Применительно к нейросетям все эти методы имеют недостаток: каждый расчет значения E требует больших затрат времени и расчета выходов всех нейронов в сети. Поэтому часто оказывается выгоднее вообще не проводить одномерного поиска, а взять в (5) шаг ε = const, пропорциональный градиенту или априорную зависимость от времени обучения ε = ε (t) для коэффициента пропорциональности между длиной шага и градиентом. Неудачный выбор априорных данных может привести к следующим последствиям

1) неточности обучения: оказавшись в окрестности локального минимума, когда требуются малые длины шага для точной настройки параметров, алгоритм с большим шагом даст неточные значения параметров;

2) медленному обучению: если шаг слишком малый, обучение может стать недопустимо медленным;

3) отсутствию сходимости, параличу сети и другим проблемам при очень большой длине шага;

|

|

|

|

Дата добавления: 2014-01-06; Просмотров: 400; Нарушение авторских прав?; Мы поможем в написании вашей работы!