КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Основные определения. Родоначальник – Клод Шеннон

|

|

|

|

Теория информации.

ЛЕКЦИЯ № 27

Родоначальник – Клод Шеннон.

Практически параллельно с ним работал Котельников.

1944 г. – грант на разработку системы криптографии (США).

Информация – это есть сведения о материальных объектах, нематериальных объектах, событиях.

Сообщение – формальное представление некоторых сведений переданных либо принятых. Сообщение содержит информацию.

Можно утверждать, что количество информации зависит от степени неопределённости содержания сообщения, т.е. от априорных вероятностей.

Пусть в канал связи поступают сообщения:

S1 = 0 и S2 = 1 с соответствующими априорными вероятностями P(S1) и P(S2).

P(S1) + P(S2) = 1

Тогда можно предположить:

1. P(S1) = 1 и P(S2) = 0  количество информации в сообщении = 0;

количество информации в сообщении = 0;

2. P(S1) = 0 и P(S2) = 1  количество информации в сообщении = 0;

количество информации в сообщении = 0;

3. P(S1) = P(S2) = 0,5  количество информации в сообщении максимально.

количество информации в сообщении максимально.

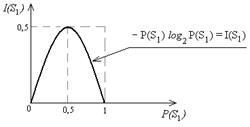

Покажем это графически для P(S1):

I(S1) – количество информации в сообщении S1

Среднее количество информации на сообщение рассчитывается из формулы мат. ожидания усреднения по множеству и называется энтропией (Н).

где k – длина кодовой комбинации.

Для k = 1 и P(S1) = P(S2) максимальное количество информации равно 1 биту.

Выводы:

1) Максимальное количество информации в сообщении будет в том случае, когда априорные вероятности появления в канале связи сообщений равны между собой. В данном случае H(S) = Hmax.

2) Учитывая, что природа источника сообщений всегда имеет различные априорные вероятности, то можно утверждать, что количество информации в сообщениях не максимально.

Пример.

Русский алфавит.

«КОЧКА»

Р(О) >> P(Ч),  в данном сообщении количество информации не максимально

в данном сообщении количество информации не максимально

3) Для того, чтобы система была защищена, необходимо изменить частость появления сообщения (символов).

4) Используя статистику появления сообщения в канале, можно увеличить количество информации, передаваемой сообщением.

5)  – коэффициент избыточности в сообщении.

– коэффициент избыточности в сообщении.

|

|

|

|

Дата добавления: 2014-01-20; Просмотров: 242; Нарушение авторских прав?; Мы поможем в написании вашей работы!