КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

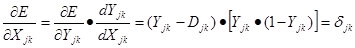

Вычисляется производная ошибки по входу активационной функции

|

|

|

|

Одним из наиболее проработанных методов обучения с учителем является метод обратного распространения, являющийся градиентным методом локальной оптимизации с вычислением производных первого порядка. Алгоритм обратного распространения был изобретен в 1974г. Полем Дж. Вербосом.

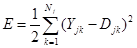

Согласно этому алгоритму вектор ошибки определяется как разность вектора выходов и эталонного вектора выходов. Подсчитывается квадрат модуля вектора ошибки, т.е. сумма квадратов разностей компонент указанных векторов. Затем меняются веса связей для минимизации ошибки. Каждый вес меняется на величину, пропорциональную скорости, с которой изменяется ошибка по мере изменения веса.

Обозначим индексом j выходной слой, i - предыдущий слой. Суммарная ошибка вычисляется следующим образом:

где Yjk - выходная активность k -го нейрона j -го слоя;

Djk - эталонный выход k -го нейрона j -го слоя.

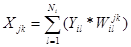

Активность нейрона есть функция его входа, например сигма-функция:

где Xjk - суммарный взвешенный вход k -го нейрона j -го слоя, который вычисляется следующим образом:

где Yil - выход l -го нейрона i -го слоя;

Wiljk - вес связи;

суммирование проводится по всем нейронам i-го слоя, связанным с данным нейроном j-го слоя.

Алгоритм обратного распространения:

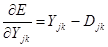

1. Вычисляется производная ошибки по активности выходного элемента:

выходного элемента:

|

|

|

|

Дата добавления: 2014-01-20; Просмотров: 526; Нарушение авторских прав?; Мы поможем в написании вашей работы!