КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Статистическая мера информации

|

|

|

|

В этом подходе используется понятие энтропии как меры неопределенность, учитывающей вероятность появления того или иного сообщения. Учитывает конкретные условия применения систем.

Статистическая мера – вероятностный подход к определению количества информации.

1948 год – Клод Шеннон.

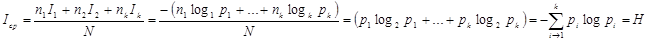

(N – количество возможных опытов, k – количество типов опытов, i – iтый исход, повторяющийся ni раз, pi – вероятность появления опыта с iтым исходом, Ii – количество информации)

Средняя информация доставляемая одним опытом определяется:

Свойства энтропии:

Свойства энтропии:

1) Всегда неотрицательна

2) Обращается в ноль, когда одно из состояний системы достоверно, а остальные невозможны

3) Если события равновероятны, то количество информации шеннона равно количеству информации по Хартли

4) Энтропия системы с конечным множеством состояний достигает максимального значения, когда эти состояния равновероятны, а при увеличении числа состояний энтропия повышается.

Количество информации – уменьшение энтропии вследствие опыта или какого-либо акта познания.

1) Если неопределенность снимается полностью количество информации равно энтропии. I=H

2) В случае неполного разрешения имеет место быть частичная информация, которая определяется как разность между начальной и конечной энтропией I=H1-H2

3) Наибольшее количество информации получается, когда полностью снимается неопределенность.

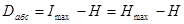

Абсолютная избыточность информации:

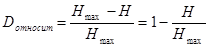

Относительная избыточность информации:

|

|

|

|

|

Дата добавления: 2015-04-23; Просмотров: 381; Нарушение авторских прав?; Мы поможем в написании вашей работы!