КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Расстояние между объектами и мера близости

|

|

|

|

Наиболее трудным и наименее формализованным в задаче классификация является определение понятия однородности объектов.

В общем случае понятие однородности объектов задается либо введением правила вычислений расстояния  между любой парой исследуемых объектов (Х1,Х2,..,Хn), либо заданий некоторой функций, характеризующей степень близости i-го и j-го объектов. Если задана функция

между любой парой исследуемых объектов (Х1,Х2,..,Хn), либо заданий некоторой функций, характеризующей степень близости i-го и j-го объектов. Если задана функция  , то близкие с точки зрения этой метрики объекты считаются однородными, принадлежащие одному классу. При этом необходимо сопоставлять

, то близкие с точки зрения этой метрики объекты считаются однородными, принадлежащие одному классу. При этом необходимо сопоставлять  с некоторым пороговым значением, определенным в каждом конкретном случае по-своему.

с некоторым пороговым значением, определенным в каждом конкретном случае по-своему.

Аналогично используются и мера близости  , при задании которой надо помнить о необходимости выполнения условий симметрии

, при задании которой надо помнить о необходимости выполнения условий симметрии  =

= ; максимального сходства объекта с самим собой

; максимального сходства объекта с самим собой

при

при  , и монотонного убывания

, и монотонного убывания  по

по  , т.е. из

, т.е. из  ≥

≥ должно следовать неравенство

должно следовать неравенство  ≤

≤ .

.

Выбор метрики или меры близости является узловым моментом исследования, от которого в основном зависит окончательный вариант разбиения объектов на классы при данном алгоритме разбиения. В каждом конкретном случае этот выбор должен производиться по – своему в зависимости от целей исследования, физической и статистической природы вектора наблюдений X, априорных сведений о характере вероятностного распределения Х.

Рассмотрим наиболее часто используемые расстояния и меры близости в задачах кластерного анализа.

Расстояние махаланобиса (общий вид)

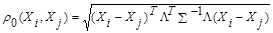

В случае зависимости компонент  вектора наблюдений Х и их различной значимости в решении вопроса квалификации обычно используют обобщенное (взвешенное) расстояние Махаланобиса, задаваемое формулой

вектора наблюдений Х и их различной значимости в решении вопроса квалификации обычно используют обобщенное (взвешенное) расстояние Махаланобиса, задаваемое формулой

, (7.1)

, (7.1)

где  ковариационная матрица генеральной совокупности, из которой извлекаются наблюдения;

ковариационная матрица генеральной совокупности, из которой извлекаются наблюдения;

- некоторая симметрическая неотрицательно-определенная матрица «весовых» коэффициентов, которая чаще всего выбирается диагональной.

- некоторая симметрическая неотрицательно-определенная матрица «весовых» коэффициентов, которая чаще всего выбирается диагональной.

Следующие три вида расстояний являются частными случаями метрики ρ0.

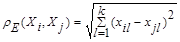

ОБЫЧНОЕ ЭВКЛИДОВОЕ РАССТОЯНИЕ

( 7.2)

( 7.2)

где  - величина l- й компоненты у i -го (j -го) объекта

- величина l- й компоненты у i -го (j -го) объекта

Использование этого расстояния оправдано в случаях, если:

а) наблюдения берутся из генеральных совокупностей, имеющих многомерное нормальное распределение с ковариационной матрицей вида  , т.е компоненты Х взаимно независимы и имеют одну и ту же дисперсию;

, т.е компоненты Х взаимно независимы и имеют одну и ту же дисперсию;

б) Компоненты вектора наблюдения Х однородны по физическому смыслу и одинаковы важны для классификации;

в) признаковое пространство совпадает с геометрическим пространством.

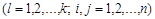

Естественно с геометрической точки зрения и содержательной интерпретации евклидовое расстояние может оказаться бессмысленным, если его признаки имеют разные единицы измерения. Для приведения признаков к одинаковым единицам прибегают к нормировке каждого признака путем деления центрированной величины на среднее квадратическое отклонение и переходят от матрицы Х к нормированной матрице с элементами

где  - значение l- го признака i -го объекта;

- значение l- го признака i -го объекта;

- среднее арифметическое значение l- го признака;

- среднее арифметическое значение l- го признака;

- среднеквадратическое отклонение l- го признака;

- среднеквадратическое отклонение l- го признака;

Однако это операция может привести к нежелательным последствиям. Если кластеры хорошо разделены по одному признаку и не разделены по другому, то после нормировки дискриминирующие возможности первого признака будут уменьшены в связи с увеличением «шумового» эффекта второго.

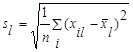

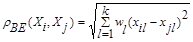

«ВЗЕШЕННОЕ» ЕВКЛИДОВО РАССТОЯНИЕ

(7.3)

(7.3)

применяется в случаях, когда каждой компоненте  вектора наблюдений Х удается приписать некоторый «вес» wl, пропорциональной степени важности признака задачи классификации. Обычно принимают 0≤ wt≤1 где l=1, 2,…,k.

вектора наблюдений Х удается приписать некоторый «вес» wl, пропорциональной степени важности признака задачи классификации. Обычно принимают 0≤ wt≤1 где l=1, 2,…,k.

Определение «весов», как правило, связано с дополнительными исследованиями, например, организацией опроса экспертов и обработкой их мнений. Определение весов wl только по данным выборки может привести к ложным выводам.

|

|

|

|

Дата добавления: 2014-01-03; Просмотров: 623; Нарушение авторских прав?; Мы поможем в написании вашей работы!