КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Формула Шеннона. Информации. Кодирование символьных, графических и звуковых данных

|

|

|

|

Информации. Кодирование символьных, графических и звуковых данных. Структуры данных

Лекция 3. Формулы Шеннона и Хартли. Расчёт количества

В общем случае, энтропия H и количество получаемой в результате снятия неопределенности информации I зависят от исходного количества рассматриваемых вариантов N и вероятностей реализации каждого из них P: {p0, p1, …pN-1}, т. е.

H=F(N, P)

Расчет энтропии в этом случае производится по формуле Шеннона, предложенной им в 1948 году:

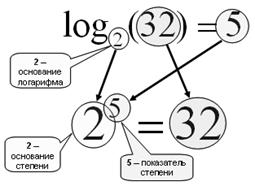

Рассмотрим, что такое логарифм log2(p), называемый двоичным логарифмом:

Нахождение логарифма b по основанию a - это нахождение степени, в которую нужно возвести a, чтобы получить b.

log2(1) = 0 => 20 = 1

log2(2) = 1 => 21 = 2

log2(8) = 3 => 23 = 8

log2(10) = 3,32 => 23,32 = 10

Логарифм по основанию 10 называется десятичным:

log10(100) = 2 => 102 = 100

log10(2) = 0,301 => 100,301 = 2

Отношение двоичного логарифма к десятичному:

log22 / log102 = 1 / 0,301= 3,32

Основные свойства логарифмов:

log(ab) = b*log(a)

log(a*b) = log(a) + log(b)

log(a/b) = log(a) - log(b)

log(1/а) = 0 - log(а) = -log(а)

Знак минус в формуле Шеннона не означает, что энтропия – отрицательная величина. Объясняется это тем, что вероятность pi =< 1 по определению, а логарифм числа меньшего единицы - величина отрицательная.

По свойству логарифма  , и формулу Шеннона можно записать также во втором варианте - без минуса перед знаком суммы.

, и формулу Шеннона можно записать также во втором варианте - без минуса перед знаком суммы.

интерпретируется как частное количество информации

интерпретируется как частное количество информации , получаемое в случае реализации i-ого случайного варианта.

, получаемое в случае реализации i-ого случайного варианта.

Из этого следует сделать вывод, что энтропию по формуле Шеннона можно считать средней характеристикой – математическим ожиданием распределения случайной величины {I0, I1,… IN-1}.

Приведем пример расчета энтропии по формуле Шеннона. Если известно, что мужчин и женщин в учреждении одинаково (два равновероятных варианта), тогда неопределенность, кого вы встретите первым, зайдя в учреждение, составит 1 бит. Проверка этого предположения проведена в таблице 1.

Таблица 1

| pi | 1/pi | Ii=log2(1/pi), бит | pi*log2(1/pi), бит | |

| Ж | 1/2 | log2(2)=1 | 1/2 * 1=1/2 | |

| М | 1/2 | log2(2)=1 | 1/2 * 1=1/2 | |

| å | H = 1 бит |

Если же в учреждении состав работников распределяется так: ¾ - женщины, ¼ - мужчины, тогда неопределенность относительно того, кого вы встретите первым, зайдя в учреждение, будет рассчитана рядом действий, показанных в табл. 2.

Таблица 2

| pi | 1/pi | Ii=log2(1/pi), бит | pi*log2(1/pi), бит | |

| Ж | 3/4 | 4/3 | log2(4/3) = 0,42 | 3/4 * 0,42 = 0,31 |

| М | 1/4 | 4/1 | log2(4) = 2 | 1/4 * 2 = 0,5 |

| å | H = 0,81 бит |

Как видно, энтропия во втором случае, а, следовательно, и количество информации, получаемой при полной определённости, несколько меньше, чем в первом случае, так как вероятность встретить женщину преобладает, и вам ясно, что скорее вы встретите женщину, чем мужчину.

|

|

|

|

Дата добавления: 2014-01-05; Просмотров: 357; Нарушение авторских прав?; Мы поможем в написании вашей работы!