КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Активационные функции

|

|

|

|

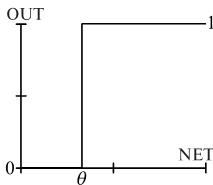

1. Жесткая ступенька:

Рис. Жесткая ступенька.

Здесь θ – пороговый уровень нейрона. Данная функция используется в классическом искусственном нейроне. Нейроны с такой нелинейностью требуют малых вычислительных затрат. Данная функция чрезмерно упрощена и не позволяет моделировать схемы с непрерывными сигналами. Отсутствие первой производной затрудняет применение градиентных методов для обучения таких нейронов.

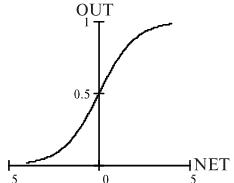

2. Логистическая функция (сигмоида):

Рис. Логистическая функция.

Эта функция часто применяется для сетей с непрерывными сигналами.

Она симметрична относительно точки с координатами NET = 0, OUT = 0,5, что делает равноправными значения OUT = 0 и OUT = 1. Тем не менее диапазон выходных значений от 0 до 1 несимметричен, что замедляет обучение соответствующей нейронной сети. Данная функция является сжимающей, т.к для малых значений NET коэффициент передачи K = OUT/NET велик, для больших значений он снижается. Поэтому диапазон сигналов, с которыми нейрон работает без насыщения, оказывается широким. Производная непрерывна и легко выражается через саму функцию, что ускоряет обучение нейрона.

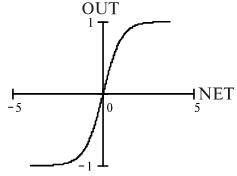

3. Гиперболический тангенс:

Рис. Гиперболический тангенс

Также часто применяется для сетей с непрерывными сигналами. Фунция симметрична относительно точки (0, 0), что является преимуществом по сравнению с сигмоидой. Производная также непрерывна и легко выражается через саму функцию.

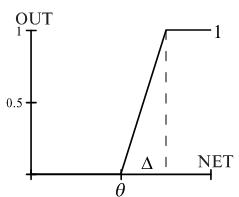

4. Пологая ступенька:

Легко рассчитывается, но имеет разрывную производную в точках NET = θ, NET = θ + Δ, что усложняет алгоритм обучения.

Рис. Пологая ступенька.

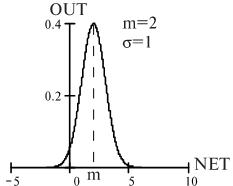

5. Гауссова кривая:  .

.

Рис. Гауссова кривая.

Применяется в случаях, когда реакция нейрона должна быть максимальной для некоторого определенного значения NET.

Выбор функции активации определяется следующими факторами:

1. Спецификой задачи.

2. Удобством реализации на ЭВМ, в виде электрической схемы или другим способом.

3. Алгоритмом обучения: некоторые алгоритмы накладывают ограничения на вид функции активации, что необходимо учитывать.

Чаше всего вид нелинейности не оказывает принципиального влияния на решение задачи. Однако удачный выбор может сократить время обучения в несколько раз.

|

|

|

|

Дата добавления: 2014-01-06; Просмотров: 1855; Нарушение авторских прав?; Мы поможем в написании вашей работы!