КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Штучна нейронна мережа

|

|

|

|

Найбільш містке визначення ШНМ таке:

Штучна нейронна мережа – це суттєво паралельно розподілений процесор, здатний зберігати і відтворювати дослідне знання.

Вона схожа з мозком людини у двох аспектах:

– мережа набуває знань у процесі навчання;

– для збереження знань мережа використовує сили міжнейронних з’єднань (синаптичних ваг).

| ||||

| ||||

| ||||

x 1

x 2

|

|

|

...

x n

Рис. 3.2. Схема штучного нейрона

Штучний нейрон, схему якого показано на рис. 3.2, працює так.

Сигнали xi (i =1,..., n), що надходять на вхід нейрона, множаться на

вагові коефіцієнти wi (синаптичні ваги). Далі вони додаються і вислі-

дний сигнал зсувається на величину w 0 порогового зсуву:

|

S = xi + w 0. (3.1)

Потім вихідний сигнал S подається на вхід блоку, що реалізує

нелінійну активаційну функцію нейрона h (S).

3.4. Типи активаційних функцій

Традиційно активаційні функції східчасті, тобто сигнал на виході

нейрона з’являється тільки тоді, коли сумарний вхідний вплив пере-

вищує певне порогове значення.

Одна з умов реалізації якогось перетворення за допомогою ШНМ –

це нелінійність її активаційної функції. Для перетворень найчастіше

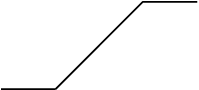

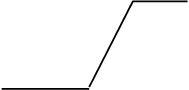

використовують такі функції: лінійні, лінійні з насиченням (рис. 3.3,

а, б); порогові функції (рис. 3.3, в, г); сигмоподібні тангенціальні фун-

кції (рис. 3.3, д); сигмоподібні логарифмічні (рис. 3.3, е); гармонічні

функції та радіально-базисні.

Хоча лінійна функція у чистому вигляді й не дозволяє реалізува-

ти будь-якого перетворення, проте вона часто може виявитись корис-

ною для простого масштабування вихідного сигналу нейрона.

|

h

S

а

h

S

в

h

S

д

Рис. 3.3. Графіки активаційних функцій: а – лінійної з насиченням;

б – лінійної з насиченням (зміщеної); в – порогової; г – порогової (зміщеної);

д – сигмоподібної тангенціальної; е – сигмоподібної логарифмічної

Сигмоподібні функції найчастіше застосовують у нейронних ме-

режах. Їх описують такими функціональними залежностями:

h (S) = -1 – тангенціальною;

1+ e - x

h (S) = – логарифмічною.

1+ e - x

Функції синуса або косинуса (гармонічні функції) досить часто

використовують у нейронних мережах для подання періодичних пе-

ретворень.

Радіально-базисна функція має такий вигляд: h (S) = e - x 2.

Наведені активаційні функції найбільш вживані, але в жодному

разі не перекривають усіх можливих.

|

|

|

|

|

Дата добавления: 2014-11-16; Просмотров: 834; Нарушение авторских прав?; Мы поможем в написании вашей работы!