КАТЕГОРИИ:

Архитектура-(3434)Астрономия-(809)Биология-(7483)Биотехнологии-(1457)Военное дело-(14632)Высокие технологии-(1363)География-(913)Геология-(1438)Государство-(451)Демография-(1065)Дом-(47672)Журналистика и СМИ-(912)Изобретательство-(14524)Иностранные языки-(4268)Информатика-(17799)Искусство-(1338)История-(13644)Компьютеры-(11121)Косметика-(55)Кулинария-(373)Культура-(8427)Лингвистика-(374)Литература-(1642)Маркетинг-(23702)Математика-(16968)Машиностроение-(1700)Медицина-(12668)Менеджмент-(24684)Механика-(15423)Науковедение-(506)Образование-(11852)Охрана труда-(3308)Педагогика-(5571)Полиграфия-(1312)Политика-(7869)Право-(5454)Приборостроение-(1369)Программирование-(2801)Производство-(97182)Промышленность-(8706)Психология-(18388)Религия-(3217)Связь-(10668)Сельское хозяйство-(299)Социология-(6455)Спорт-(42831)Строительство-(4793)Торговля-(5050)Транспорт-(2929)Туризм-(1568)Физика-(3942)Философия-(17015)Финансы-(26596)Химия-(22929)Экология-(12095)Экономика-(9961)Электроника-(8441)Электротехника-(4623)Энергетика-(12629)Юриспруденция-(1492)Ядерная техника-(1748)

Навчання без вчителя (unsupervised training)

|

|

|

|

Розглянуті вище алгоритми навчання ШНМ за допомогою процедур зворотного поширення похибки, випадкового пошуку або генетичних алгоритмів припускають наявність деякої зовнішньої ланки, що надає мережі крім вхідних образів також і цільові вихідні образи. Алгоритми, що використовують подібну концепцію, називають алгоритмами навчання з вчителем. Для їх успішного функціонування потрібні експерти, які створюють на попередньому етапі для кожного вхідного образу еталонний вихідний. Оскільки створення штучного інтелекту розвивається шляхом копіювання природних прообразів, вчені не припиняють сперечатись щодо того, чи можна вважати алгоритми навчання з вчителем натуральними, чи вони повністю штучні. Наприклад, навчання людського мозку, на перший погляд, відбувається без вчителя: на зорові, слухові, тактильні та інші рецептори надходить інформація ззовні, і всередині нервової системи відбувається певна самоорганізація. Однак не можна заперечувати й того, що в житті людини немало вчителів – і в буквальному, і в переносному сенсі, – тих, що координують зовнішні впливи. Проте, чим би не закінчилася су

перечка прихильник і цих двох концепцій навчання, вони обидві мають право на існування.

Головна перевага навчання без вчителя – це його «самостійність». Процес навчання без вчителя, як і навчання з вчителем, полягає у підстроюванні ваг синапсів. Деякі алгоритми, однак, змінюють і структуру мережі, тобто кількість нейронів і їх взаємозв’язки, але такі перетворення правильніше назвати більш широким терміном «самоорганізація», та в межах цього матеріалу ми їх не розглядатимемо. Очевидно, що підстроювати синапси можна тільки на основі інформації, доступної в нейроні, тобто його стану і вже наявних вагових коефіцієнтів. Виходячи із цієї думки і, що більш важливо, за аналогією з відомими принципами самоорганізації нервових клітин, побудовані алгоритми навчання Хебба.

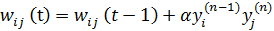

Сигнальний метод навчання Хебба полягає в зміні ваг за таким правилом обчислень:

, (4.9)

, (4.9)

де  - вихідне значення i -го нейрона (n-1) шару;

- вихідне значення i -го нейрона (n-1) шару;  - ви хідне значення j -го нейрона шару n;

- ви хідне значення j -го нейрона шару n;  та

та  - ваговий коефіцієнт сина пса, що з’єднує ці нейрони на ітераціях t і t- 1 відповідно; a - коефіцієнт швидкості навчання. Тут і надалі, для загальності, літерою n позначають довільний шар мережі. Під час навчання за цим методом підсилюються зв’язки між збудженими нейронами.

- ваговий коефіцієнт сина пса, що з’єднує ці нейрони на ітераціях t і t- 1 відповідно; a - коефіцієнт швидкості навчання. Тут і надалі, для загальності, літерою n позначають довільний шар мережі. Під час навчання за цим методом підсилюються зв’язки між збудженими нейронами.

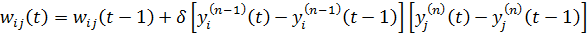

Є також і диференціальний метод навчання Хебба:

, (4.10)

, (4.10)

де yi( n−1) (t) і yi( n−1) (t −1) – вихідне значення нейрона i шару n – 1 відповідно на ітераціях t і t – 1;  і

і  - те ж саме для ней-

- те ж саме для ней-

рона j шару n. Як видно з формули (4.10), найбільше навчаються синапси, що з’єднують ті нейрони, виходи яких динамічно збільшаться.

Повний алгоритм навчання у цьому випадку буде виглядати так:

Крок 1. Привласнення малих випадкових значень на стадії ініціалізації всім ваговим коефіцієнтам.

Крок 2. Подача вхідних образів на входи мережі і поширення сигналів збудження по всіх шарах відповідно до принципів класичних прямопоточних (feedforward) мереж, тобто для кожного нейрона розраховується зважена сума його входів, до якої потім застосовується активаційна (передатна) функція нейрона, в результаті чого отримується його вихідне значення.

Крок 3. Зміна вагових коефіцієнтів на основі отриманих вихідних значень нейронів за формулою (4.9) або (4.10).

Крок 4. Повторення, починаючи з кроку 2, доки вихідні значення мережі не установляться із заданою точністю.

Завершення навчання за новим способом, відмінним від використовуваного для мережі зворотного поширення, зумовлене тим, що підстроювані значення синапсів фактично не обмежені. На другому кроці циклу поперемінно подаються всі образи із вхідного набору.

Слід зазначити, що відгук на кожен з класів вхідних образів не відомий заздалегідь і являтиме собою довільне сполучення станів нейронів вихідного шару, зумовлене випадковим розподілом ваг на стадії ініціалізації. Разом з тим, мережа здатна узагальнювати схожі образи, визначаючи їх приналежність до одного класу.

5. НЕЙРОННІ МЕРЕЖІ В СИСТЕМАХ КЕРУВАННЯ

|

|

|

|

|

Дата добавления: 2014-11-16; Просмотров: 488; Нарушение авторских прав?; Мы поможем в написании вашей работы!